Schaltalgebra

[ zurück ]

[ Stichworte ]

[ Die Hyper-Bibliothek ]

[ Systemtheorie ]

[ Meine Bücher ]

Als Schaltalgebra bezeichne ich eine algebraische Notation, die sich auf Schaltungen bezieht.

Die "Entdeckung" von C. Shannon, dass Schaltungen in Form einer Gatter-Logik mittels der algebraischen Operatoren (AND, OR) beschrieben werden können, erlaubte das Berechnen von Schaltungen und das Rechnen mittels Schaltungen. Schliesslich erkenne ich in der Schaltalgebra die Grundlage der Programmiersprache, da sie die sekundäre Lesbarkeit ...

Das deutsche Wort hat K. Zuse verwendet, ich weiss nicht ob er es geschaffen hat.

H. Zuse schreibt: "Schaut man sich die Technologie der Z1 an, dann sieht man Tausende Bleche. Wie kann man mit Blechen rechnen?"

Geschichte:

Die ersten Logikgatter wurden mechanisch realisiert. 1837 entwarf C. Babbage mit der Analytical Engine einen mechanischen "Computer". Später wurden dann Relais, und Röhren und schliesslich Transistoren in ICs verwendet.

1891 meldete der US-Amerikaner Almon Strowger eine „Einheit, die einen Logikgatter-Schalterstromkreis enthält” zum Patent an, die sich jedoch bis in die 1920er Jahre nicht etablieren konnte. 1898 begann N. Tesla mit der Archivierung und Verfeinerung solcher Einheiten und setzte den Einsatz von Elektronenröhren anstatt Relais durch. Lee De Forest änderte das Schaltungskonzept der Flemingschen Elektronenröhre im Jahr 1907 schließlich derart, dass es als UND-Gatter verwendet werden konnte.

L. Wittgenstein führte 1921 im Theorem 5.101 seiner Abhandlung Tractatus Logico-Philosophicus die erste Wahrheitstabelle ein. C. Shannon fundierte 1937 (A Symbolic Analysis of Relay and Switching Circuit) die Überlegungen Wittgensteins mit der Einführung der Booleschen Algebra in der Auswertung und der Gestaltung von Stromkreisschaltungen. Walther Bothe bekam 1954 den Nobelpreis in Physik für das erste moderne, elektronische UND-Gatter aus dem Jahr 1924.

siehe auch: Mikrocomputer, J. Kilby

und quasi als Gegenteil: Computeralgebra

A. Osborne: Mikrocomputer-Technik, Halbaddierer

Die deutsche Wikipedia unterscheidet Boolesche Algebra und Schaltalgebra

Die englische Wikipedia leitet "Switching algebra" auf "Boolean algebra" weiter und schreibt: [ ]

1938 benutzte C. Shannon die Notation in einem Kalkül für Schaltkreise, wofür die Bezeichnung Schalt-Algebra verwendet wird. Algebra bezeichnet auch in diesem Fall nur die Notation. Mit Gleichungen und mit Aussagenlogik hat das Kalkül nichts zu tun.

Durch die Schalt-Algebra können Speicherplätze in einem Prozessor über Variablennamen adressiert und ansprochen werden. Darauf beruht die Programmierung mittels Programmiersprachen (im Unterschied etwa zur Programmierung durch Steckverbindungen).

Peacock, George

Die Algebra - das ist hier ein wesentlicher Punkt - führt die Bezeichnung von Variablen ein.

Durch die Schalt-Algebra können Speicherplätze in einem Prozessor über Variablennamen adressiert und ansprochen werden. Darauf beruht die Programmierung mittels Programmiersprachen (im Unterschied etwa zur Programmierung durch Steckverbindungen).

"Kann nicht einfach gesagt werden, daß ein Computerprozessor die “technische Realisierung” der Booleschen Algebra darstellt?"

Nein, das Problem der boolschen Algebra besteht darin, dass sie nicht in der Zeit arbeitet. Sie steht für ahistorisches Denken, also für ein Denken das durch die Kybernetik/Systemtheorie ersetzt wurde.

....auch immer näher an das Verständnis der jeweiligen “Problemdomänen” heranrücken können

nein, das betrifft einen sehr wichtigen Punkt. Ich kann den Computer als Maschine, also als kybernetischen Mechanismus betrachten und ich kann unabhängig davon - also ohne einen Computer zu verwenden - einen Unternehmens/Organisationsprozesse kybernetisch modellieren. Das sind zwei völlig verschiedene Dinge - wenn ich sie nicht heil- und begriffslos vermenge, wie es die übliche IT-Redeweise tut.

Die “Vereinfachungsthese” (also: höhere Programmiersprachen sind einfacher als das Hantieren mit maschinensprachlichen Befehlssequenzen) ...

Eine "Vereinfachungsthese" stammt von den Cobol/Fortran-Erfindern, sie zielte auf idiotische Programmierer.

Eine ganz andere Vereinfachungsthese beruht darauf, dass Prozesse modularisiert und dann hinter die Sichtbarkeitsgrenze gesetzt werden. Ich muss mich beim Programmieren beispieslsweise nicht mehr darum kümmern wie eine "while-Schlife" realisiert wird. Aber ich muss mich darum kümmern wie ich sie verwende. Das heisst ich werde von bestimmten Aufgaben entlastet und kann deshalb andere Aufgaben übernehmen. Meine Tätigkeit wird dadurch wohl anspruchsvoller nicht einfacher.

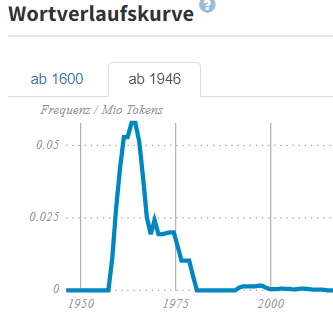

Auch hier geht es also um zwei sehr verschiedene Ideen von Vereinfachung. Deine Folgerung vermengt die beiden Aspekte - die in der Automatisierungs-Soziologie (Qualisfizierungs/Dequalifizierung-Diskussion in den 1970er) ausführlich behandelt wurden.

Algebra ist eine flache-Erde-Auffassung der Schaltalgebra. Ich finde ganz typisch, dass in der Schule immer noch Algebra unterrichtet wird.

[wp]